先做个广告:如需代注册ChatGPT或充值 GPT5会员(plus),请添加站长微信:gptchongzhi

12天的直播,最后一天放出来的东西大家都知道是个大招,挺多人猜GPT5的,因为最后压轴的大概率是大模型本身。

推荐使用GPT中文版,国内可直接访问:https://ai.gpt86.top

推荐使用GPT中文版,国内可直接访问:https://ai.gpt86.top

因为升级大模型,特别是对于OpenAI这种标杆公司,每一次的模型升级,基本上都代表了AI大模型领域的某种风向。

这次压轴大菜上的是o3模型,包括我在内的很多人都很疑惑,o1之后为什么不是o2,而是o3。

OpenAI的CEO山姆奥特曼特意解释了原因,就是他们公司非常不擅长起名字,然后o1之后就直接o3了。(可能这就是任性吧)

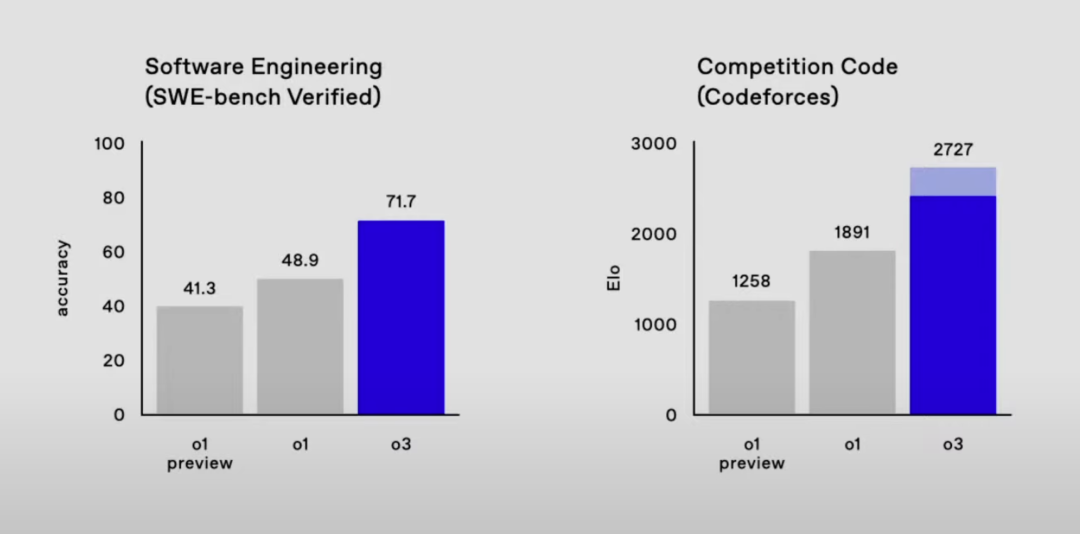

其实OpenAI的o系列模型,最大的特点就是擅长推理。比如说编程中涉及到了推理,数学也需要,物理化学这样的理科学科也需要大量的推理,而o系列在这样的任务中表现的尤其突出。

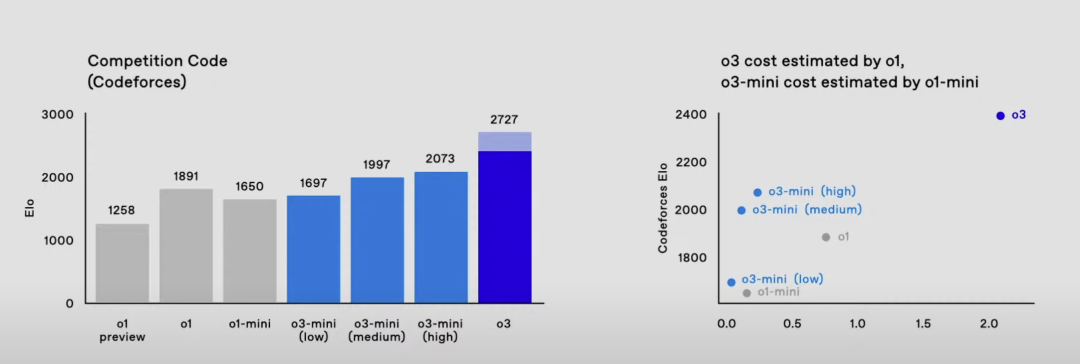

新的o3模型在推理上更进一步,在Software Engineering和Codeforeces这俩测试上分数相比它的上一代,o1模型提升很大。

第一个测试集的分数从48.9提升到了71.7,第二个从1891到2727,提升幅度很大。

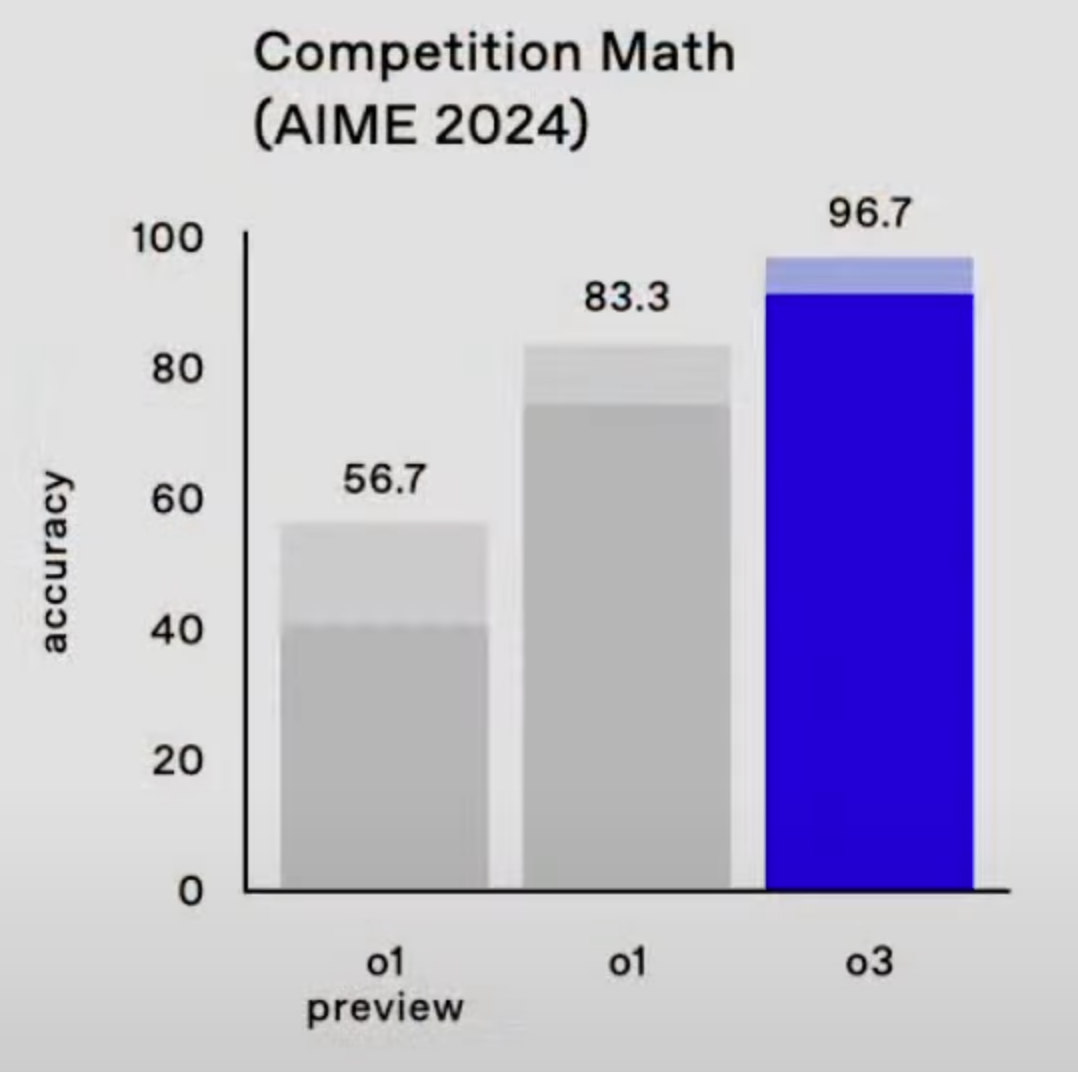

然后在数学上也有了提升,在AIME这个测试集上o1就已经达到了83.3,o3直接把准确率提升到了96.7,几乎相同于一套数学卷子只错一个的程度。

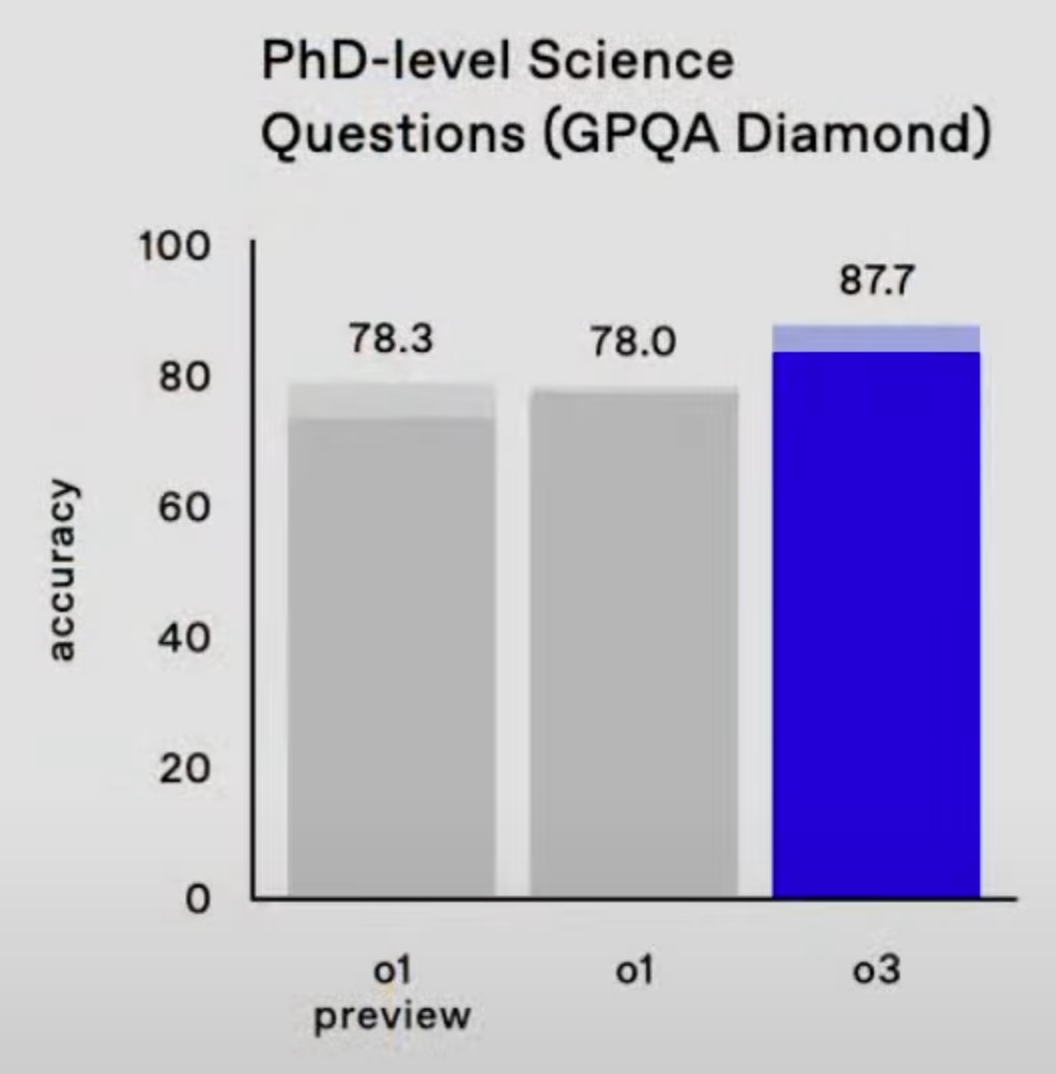

然后下一个测试集叫GPQA,它是一个博士生级别的问题测试集,如果要某个学科的博士来答题,一般能拿到70分左右。

o1模型可以做到78分左右,o3直接把分数拉到87.7,远超人类选手的程度。

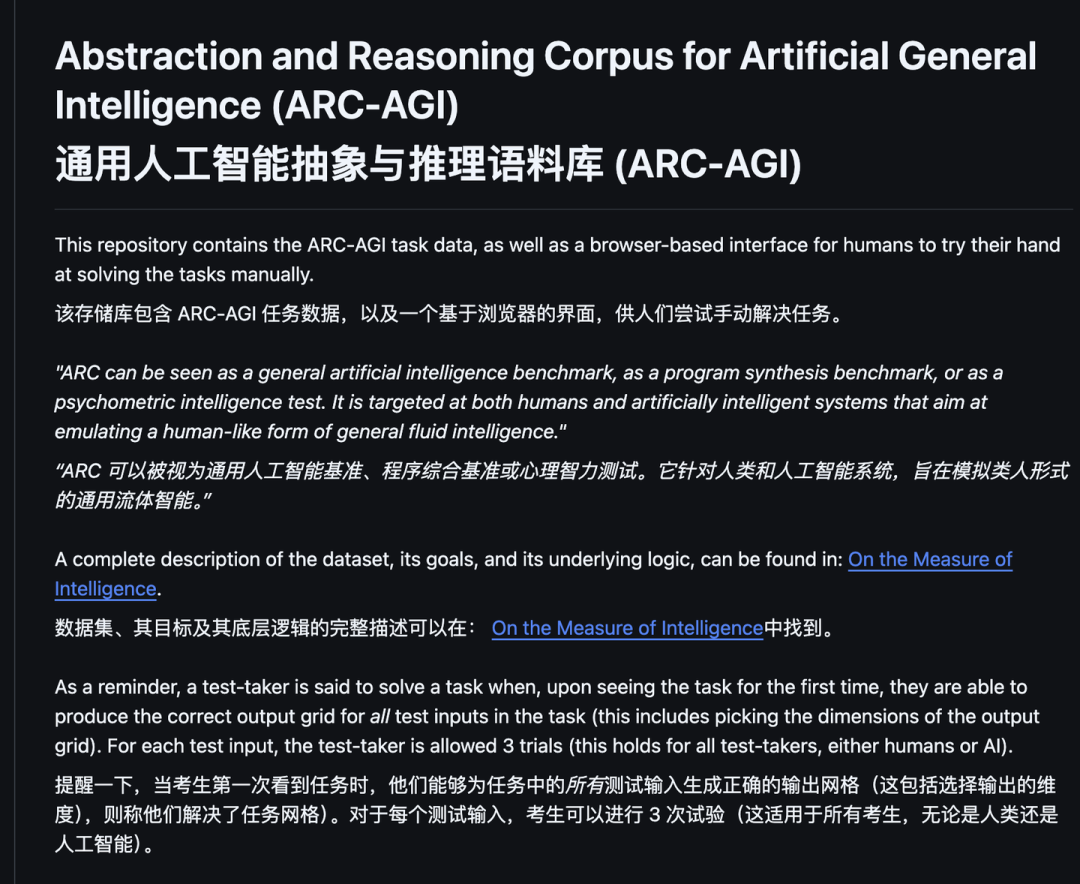

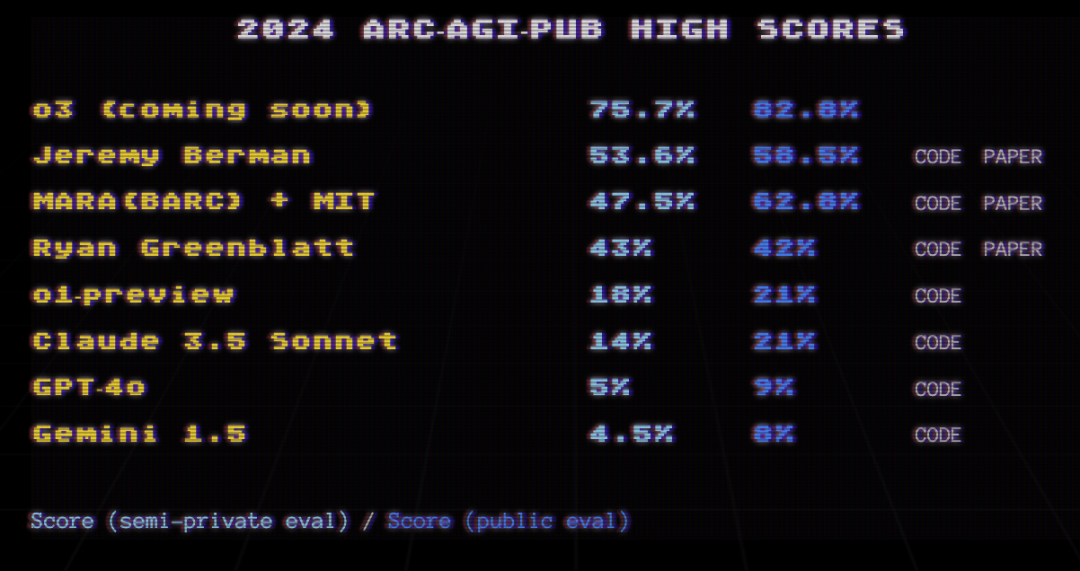

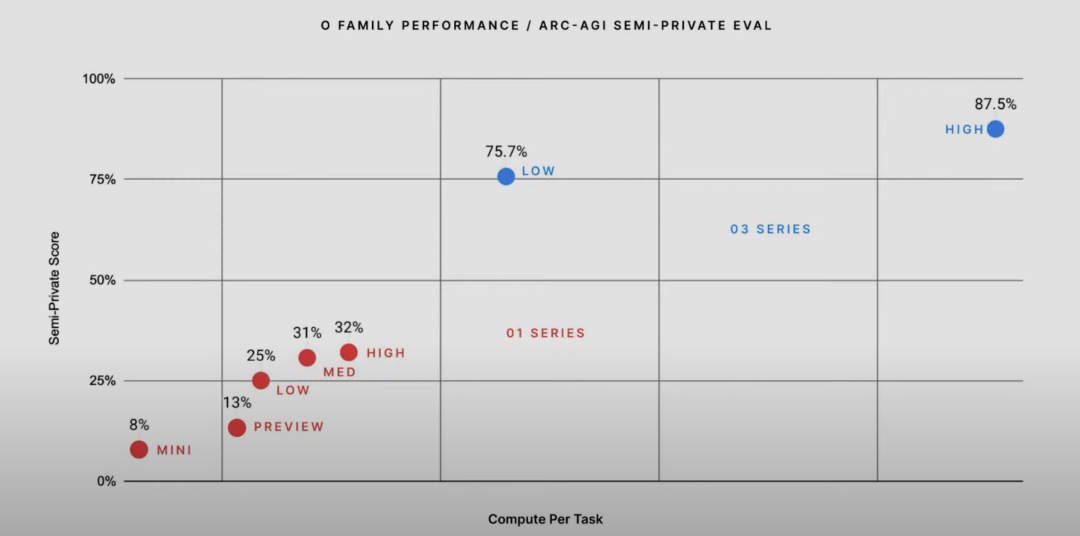

除了这几个很常见的测试集,甚至引入了一个不太常见的测试集ARC AGI,它的全称是Abstraction and Reasoning Corpus for Artificial General Intelligence,专门设计出来测试AI。

这个相比大多数测试用的数据集都要难,其中的题目大多是这种推理问题,下面是一个简单的例子,凭借直觉就能答得上来。

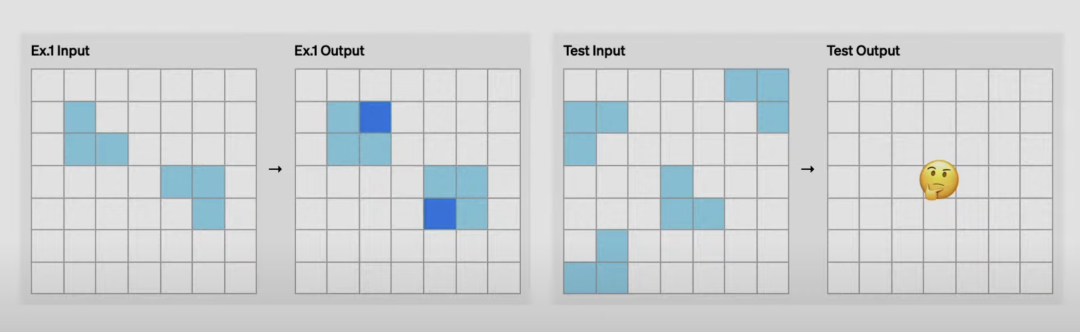

但是有些题目难度很高,比如下面这个。

黄色块中有几个其他色块,新图像外面就有几层相同色块。

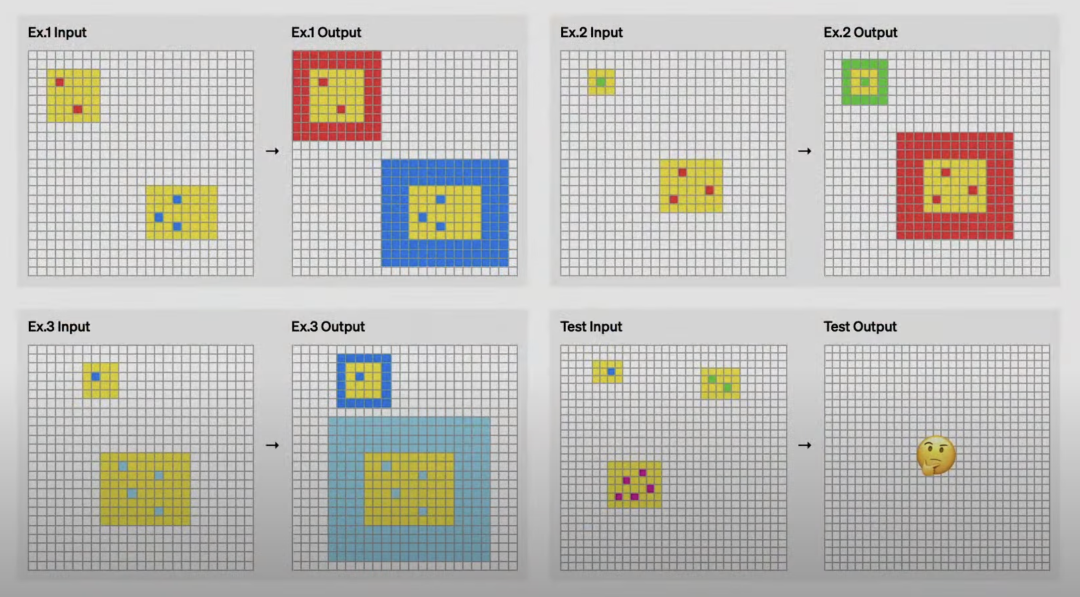

你可以看到GPT4o只有9%的分数,但是o1直接翻了两倍多到了21%,o3的分数远超第二名的60%,达到了82.8%。

你可以看ARC AGI主席公开的数据,o系列模型性能提升太线性了,甚至有点儿过于线性。

o3模型有几个形态,除了o3,还有o3 mini,应该是蒸馏出来的小模型,mini版本也分为三种类型,分类的标准是推理消耗的计算资源。

分为low,medium以及high三种,满足计算资源给的越多,性能越好的定理。

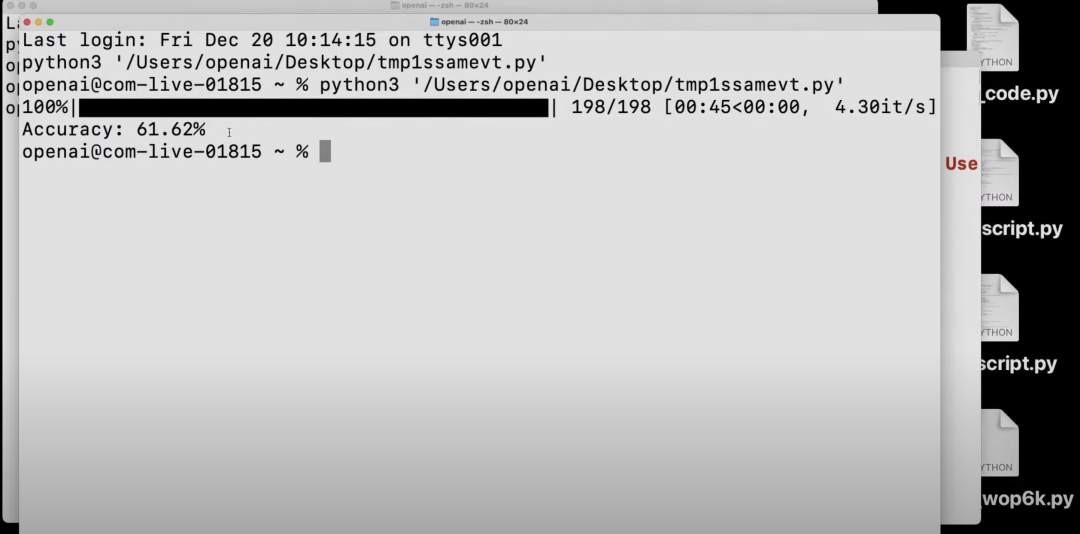

直播中测试了o3 mini low模式,用它做198道题,速度极快,只用了45秒,准确率61.62%,估计用high模式或者o3满血版,可能分数会提升非常大。

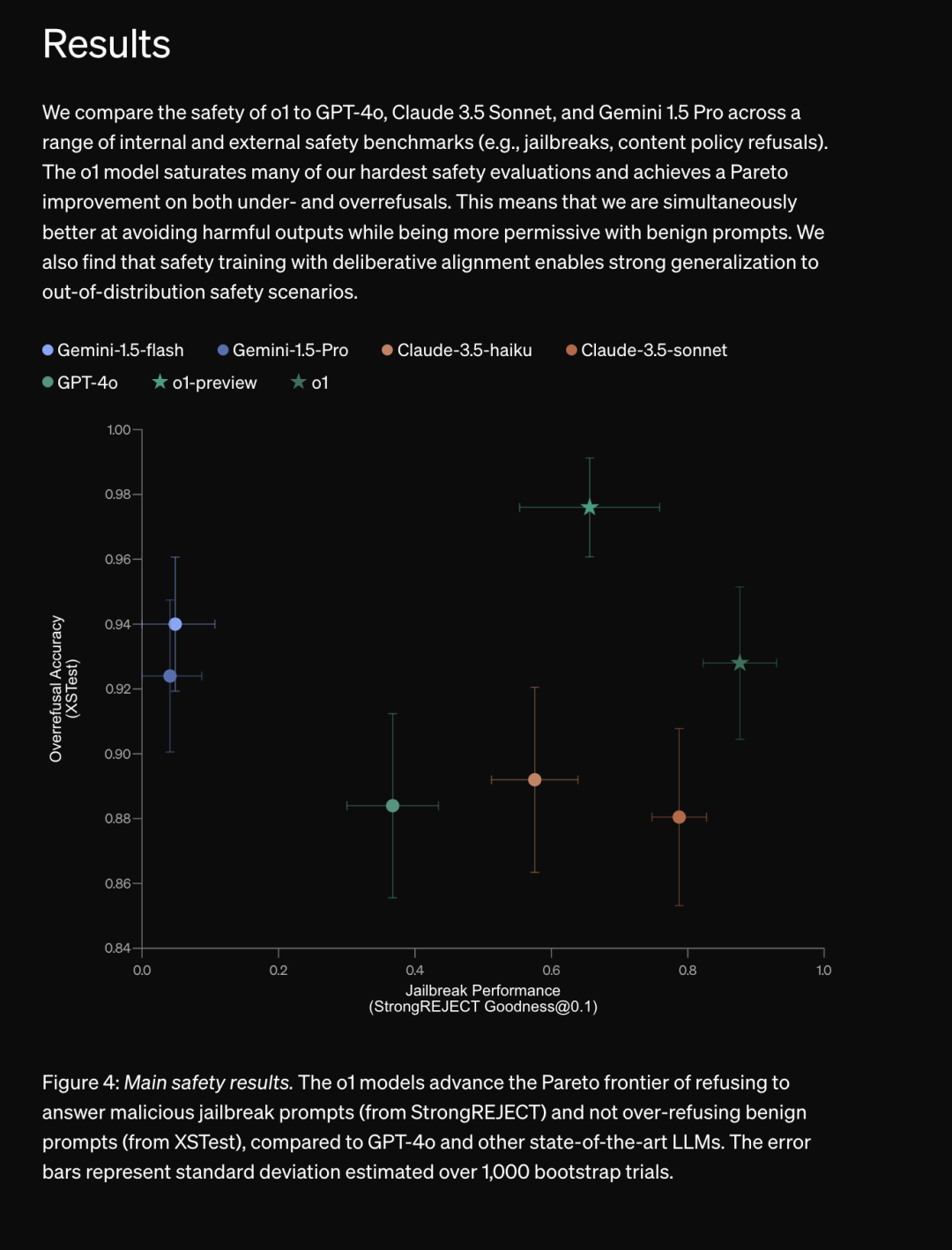

最后,OpenAI提到了他们对于安全性的升级,总的来说,就是让模型可以在这两个维度上达到了很优化的平衡。

它们用下面两个维度做了评估:

拒绝恶意提示(jailbreaks):测试模型是否能拒绝回答恶意请求,如绕过政策或生成有害内容。

避免过度拒绝(overrefusal):检查模型在处理无害请求时是否会过于保守而拒绝回答。

o1 模型(深绿色星形)在拒绝恶意提示方面表现突出,同时对无害提示也更宽容,达到安全性和灵活性的平衡。

GPT-4o 表现较好,但相较于 o1 模型,在灵活性或安全性之间略显妥协。Claude 3.5 和 Gemini 1.5 模型分别在某些方面表现突出,但无法同时兼顾两方面优化。

这一切的原因都来自于安全方面的考虑:

·大型语言模型容易受到对抗性攻击(例如越狱攻击、滥用内容等)的威胁,同时可能过于保守,对无害请求拒绝回答。

·主要挑战:

a.如何防止模型生成有害内容?

b.如何避免对无害输入的过度拒绝?

现有方法的缺陷:

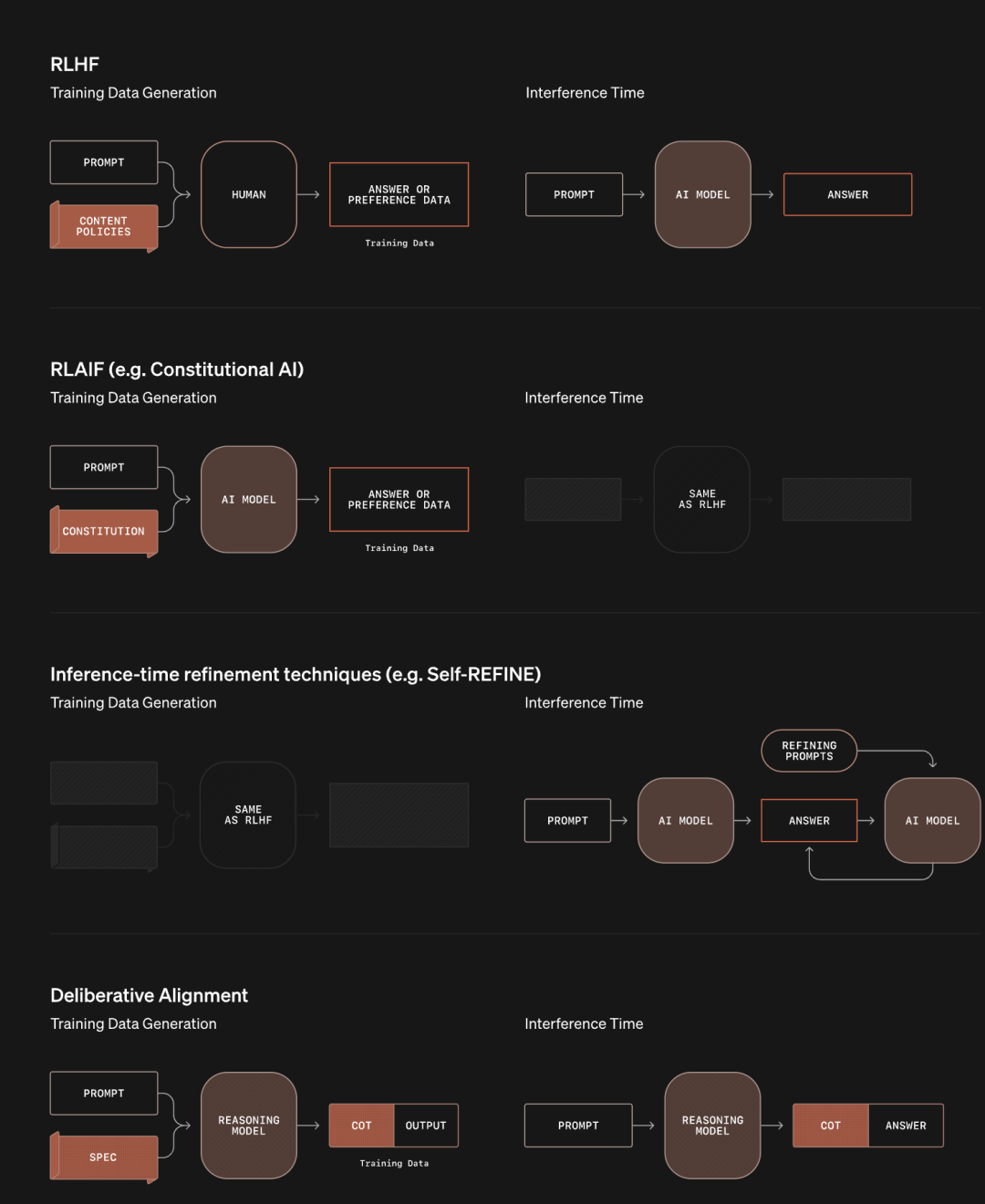

·传统方法依赖于“强化学习奖励优化”(RLHF)和“对抗性训练”(Adversarial Training),但这些方法存在以下问题:

a.过度依赖人工标注,训练成本高,且难以扩展。

b.泛化能力较差,在处理分布外输入(out-of-distribution)时表现不稳定。

🌟新方法 - 深思熟虑的对齐 (Deliberative Alignment):

·提出了一个新型训练框架,结合了过程监督和结果监督,以改进模型的安全性和泛化能力。

·自动生成训练数据,减少人工依赖,提升对恶意提示的抵抗能力,同时减少对无害请求的过度拒绝。

下面的图片详细的介绍了几个不同模型训练和推理的逻辑,o3采用的方法更多的利用了COT以及包含了大量的推理。

END

本文链接:https://shikelang.cc/post/1779.html

o3 minio3openai o3 miniopenai o3chatgpt o3 minichatgpt o3o3 mini官网openai o3官网

网友评论