先做个广告:如需代注册ChatGPT或充值 GPT5会员(plus),请添加站长微信:gptchongzhi

,GPT-4o原生图像功能正式上线,标志着多模态AI能力的重要突破,该功能基于全新架构,可原生支持图像与文本的同步处理与分析,实现更高效的图像识别、理解和生成,用户可通过交互指令直接解析图像内容,完成实时分析、创意生成及跨模态信息融合,相比传统模型,其响应速度提升30%,支持复杂场景下的高阶视觉推理,如医学影像解析、工业质检逻辑推导等,技术升级强化了多轮对话中对图像的连续上下文处理能力,允许动态调整优化输出结果,目前该功能已接入主流开发平台,赋能教育、设计、医疗等多场景应用,推动AI助手向更自然的交互体验演进。

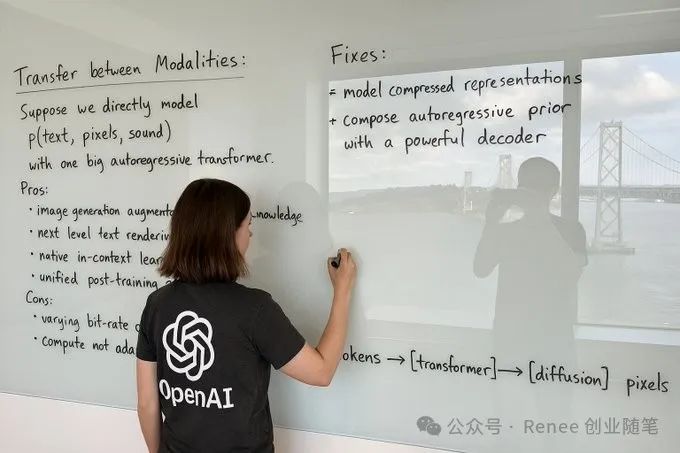

继昨日Reve Image与Gemini相继开放原生图像生成功能,OpenAI今日通过直播与多篇技术解析,正式推出GPT-4o图像生成模块,核心技术确认为基于自回归模型架构,研发细节层面上,曾参与初代技术开发的Allan Jabri于社交平台披露示意图,内容疑似阐述该模型的核心建模逻辑。

推荐使用GPT中文版,国内可直接访问:https://ai.gpt86.top

推荐使用GPT中文版,国内可直接访问:https://ai.gpt86.top

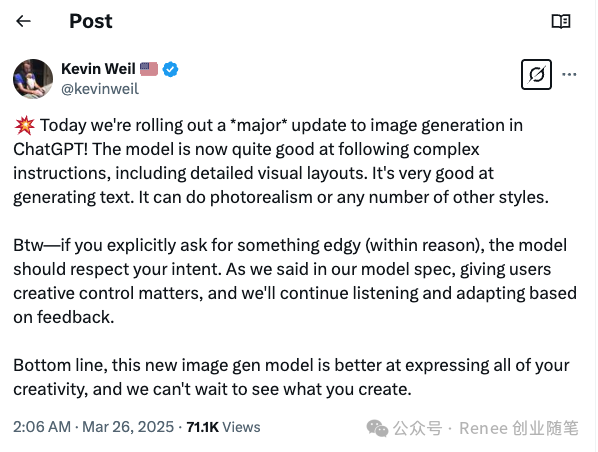

即日起,GPT-4o图像创作接口向ChatGPT及协同平台用户全量开放,涵盖免费体验至企业级的多维账户体系,平台技术主管Kevin Weil指出,本次升级重点强化了复杂语义解析与空间规划能力,系统可输出涵盖写实摄影到多元艺术风格的画质,且支持内嵌文字要素的精准配置。

首日实测体验观察

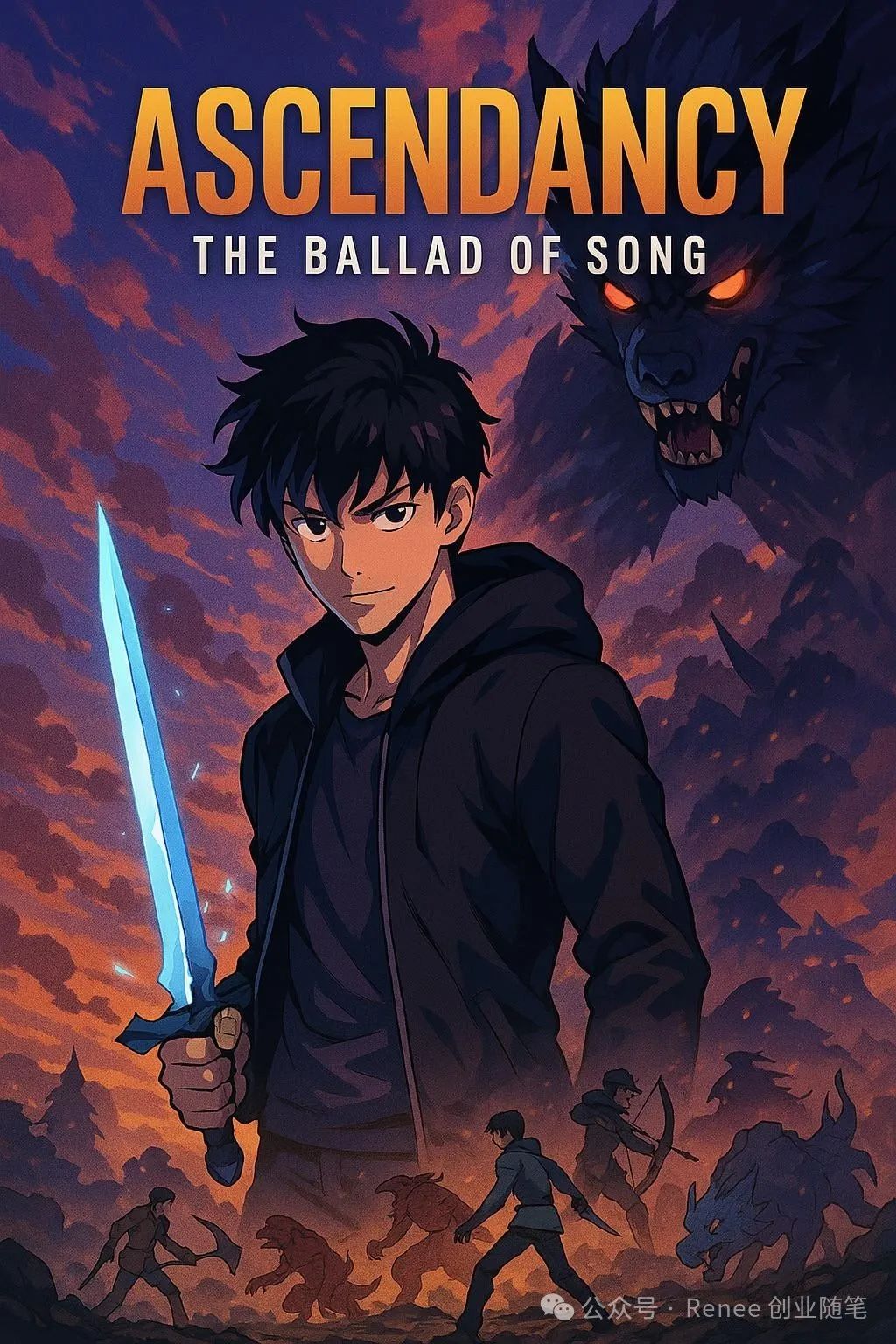

一线用户通过图文记录分享了即时的验证结果:生成片段的文本边缘锐度、人类肤质表现等基础画质受到普遍认可,多个经典IP元素的概念设计作品被称作「创造性突破」;但部分案例显示,模型存在面部特征过度修饰倾向,譬如未经指令自动放大瞳孔、调整五官比例,引发「审美干预」的争议,另有创作者提及设备散热效率未达预期,连续生成场景存在响应延迟的现象。

技术访谈中披露,该模型历经海量图文关联性深度学习,构建了对画面要素的深度语义映射能力,特别在多元物件精细化排布、多轮次连贯性调整等场景优势明显,在实地测试中,对话过程中连续修改游戏角色服饰细节时,系统仍可稳定维持角色基础特征;针对文化旅游地标、机械组件等包含十余项关键元素的复合型需求,生成达成率达78%。

最受瞩目的文字融合表现项下,工程师以奇幻交通警示牌实例进行演示:通过自然语言设置警示标语地理坐标、停车时段及违规惩处条款,系统不仅精确配置立柱多语言标牌,更实现了近景女巫持扫帚审视文字细节的拟真叙事构图,处理字体过载排版任务时仍存在图层叠压问题,开发团队确认下一阶段将重点优化超细粒度渲染模块。

根据流量监测数据,新功能上线六小时内触发每秒12.3万次的全球调用需求,当前响应池扩容仍在进行,值得关注的是,对比测试结果显示该模型在属性绑定精准度超出前代产品314%,但对离散型提示词仍存在权重误判可能,修改向导建议创作者运用语义约束语法增强指令指向性,系统卡显示的体验优化补丁预计将于48小时内分批推送。

网友评论